微软在Windows 11 AI功能的安全性表述上陷入了明显的自相矛盾:一边在社交平台高调宣称,Windows 11能“轻松、安全且可靠地”赋能用户使用AI,将系统定位为AI的“画布”;另一边却在官方支持文档中坦诚,系统内置的AI代理存在幻觉、跨提示注入攻击等风险,甚至可能引发数据窃取、恶意软件安装等非预期操作。这种割裂的表态,折射出微软在推进AI战略时,平衡功能创新与安全风险的两难处境。

矛盾的核心:“安全赋能”宣传 vs 明确的风险警告

微软对Windows 11 AI的两种表述,完全站在对立面,且均出自官方渠道:

- 营销端的“安全叙事”

在X平台的推广帖中,微软将Windows 11定义为**“AI的画布”**,强调系统从底层架构、芯片到硬件都深度整合AI能力,能帮助企业从AI实验转向大规模落地。同时反复强调,Windows 11可以让用户“轻松、安全且可靠地”使用AI功能,并呼吁开发者为Copilot+ PC(搭载骁龙处理器、配备NPU的设备)打造专属AI应用。

这种宣传的核心目标,是推动Windows 11的“AI优先”转型,吸引用户和开发者投入其AI生态。 - 技术文档中的“风险实言”

在面向用户的支持文档里,微软毫不避讳地列出了AI代理的安全隐患:- 幻觉引发误操作:AI模型可能产生错误判断,在访问个人文件、文件夹时执行非预期动作,比如错误重命名文件、篡改文档内容;

- 新型攻击风险:明确提及跨提示注入攻击(XPIA)——恶意内容可嵌入在UI元素或文档中,覆盖AI代理的原始指令,进而诱导代理执行数据窃取、安装恶意软件等恶意行为;

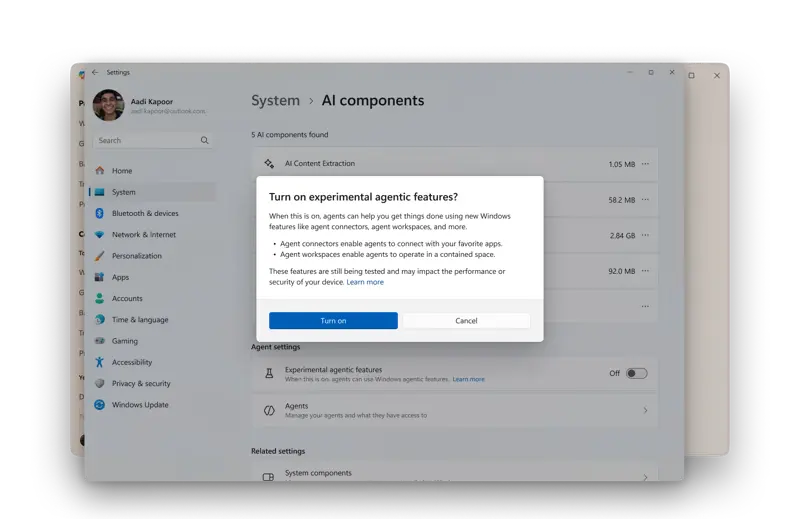

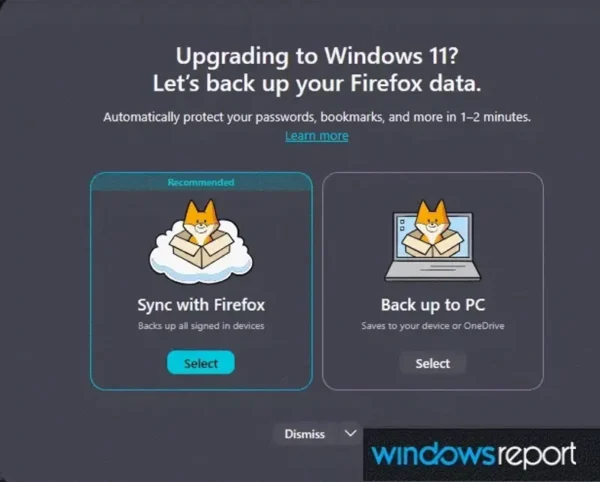

- 强制风险提示:在Windows 11预览版中,用户开启代理式AI功能时,会弹出醒目的安全警告弹窗,提醒潜在危害,且该功能默认处于关闭状态,需手动启用。

这种“一边喊安全,一边说风险”的操作,本质是微软在商业推广与用户知情权之间的妥协——既想借AI概念提振Windows生态活力,又不得不正视技术本身的局限性。

Windows 11 AI的核心能力与安全边界

微软力推的“代理式AI”,是Windows 11 AI功能的核心,其能力与风险并存:

- 代理式AI的核心价值

AI代理可代表用户执行自动化任务,例如通过Copilot的“操作”功能,对个人文件进行批量重命名、分类整理,甚至联动系统设置和第三方应用完成复杂流程。这些功能基于代理工作空间运行,且支持通过**模型上下文协议(MCP)**的连接器,与OneDrive、文件资源管理器等应用深度交互。

对普通用户而言,这意味着更低的操作门槛;对企业来说,则是提升办公效率的潜在工具。 - 安全边界的模糊性

尽管微软为AI代理设置了“访问文件需用户同意”的权限规则,但仍存在两个关键安全漏洞:- 权限粒度不足:用户只能选择“允许/禁止”代理访问全部六个已知文件夹(桌面、文档等),无法单独授权某一个文件夹,存在“要么全开放,要么全封闭”的尴尬;

- 公共文件夹默认可访问:AI代理账户能直接读取所有已验证用户有权限的公共文件夹,无需经过用户同意,这为恶意攻击留下了可乘之机;

- 攻击手段的隐蔽性:跨提示注入攻击(XPIA)无需突破系统权限,只需通过恶意文档或UI元素即可诱导AI代理作恶,传统杀毒软件难以识别防御。

“AI画布”:微软的战略叙事,还是历史的重复?

微软将Windows 11称为“AI的画布”,并非突发奇想,而是其惯用的系统定位转型策略。回顾Windows的发展历程,类似的“战略叙事”曾多次出现,但大多未能达到预期效果:

- Windows 8的“触控优先”

微软曾试图将Windows 8打造成面向平板电脑和二合一设备的触控优先系统,大幅修改传统桌面UI,强推磁贴界面和应用商店生态。但这种转型忽略了Windows的核心用户群体——依赖键鼠操作的桌面用户,最终因体验割裂而失败。 - Windows 10创意者更新的“创作者定位”

微软曾为Windows 10推出创意者更新,聚焦3D内容创作、Paint 3D、混合现实等功能,试图吸引设计师、创作者群体。但这些功能受众面窄,且与专业创作软件相比缺乏竞争力,最终未能改变用户对Windows的核心认知。

如今的“AI画布”叙事,与前两次如出一辙:微软试图通过一个核心概念,重新定义Windows的价值定位。但问题在于,微软再次忽略了Windows的根本属性——稳定、可靠的生产力工具。用户对AI功能的需求,是“锦上添花”而非“取而代之”,若安全风险无法妥善解决,再华丽的“AI画布”也难以获得用户信任。

矛盾背后的深层原因:AI转型的紧迫性与技术局限性

微软之所以出现这种自相矛盾的表态,本质是两大因素的碰撞:

- 市场竞争的紧迫性

在生成式AI浪潮下,谷歌、苹果等科技巨头都在加速布局AI与操作系统的融合(如谷歌的Gemini、苹果的Apple Intelligence)。微软若不快速推进Windows 11的AI转型,可能会在下一代操作系统竞争中掉队。因此,即使安全风险尚未完全解决,微软也必须高调宣传其AI能力,抢占市场先机。 - AI技术的固有局限性

当前的生成式AI模型,无论是逻辑推理还是风险防控,都存在无法根除的缺陷——幻觉、被恶意诱导是行业共性问题。微软无法在短期内彻底解决这些技术瓶颈,只能在宣传上强调“安全”,同时在技术层面设置权限管控、风险提示等被动防御措施。

写在最后:用户该如何看待Windows 11 AI?

对普通用户而言,无需对Windows 11 AI功能过度恐慌,也不应轻信“绝对安全”的宣传,可遵循三个原则:

- 按需启用:AI代理是可选功能,若没有自动化任务需求,建议保持关闭状态,从根源规避风险;

- 谨慎授权:若需使用,优先选择“每次询问”的权限模式,避免授予“始终允许”的长期权限;

- 警惕陌生文档:不随意打开来源不明的文档、链接,降低跨提示注入攻击的风险。

微软的矛盾表态,其实是整个AI行业的缩影——在技术尚未成熟的阶段,商业化推广与安全底线之间的平衡,始终是一道难解的题。

评论